用卡通头像在社交网络和短视频平台录制视频是很多人喜欢玩的游戏,但我们也发现了一些问题,比如头像的调整范围窄,和我不太像。

近日,新加坡南洋理工大学的一项相关研究在reddit和Twitter上获得了数千个赞。他们开发了一个能够控制高分辨率人像视频风格迁移的框架——VToonify,它在风格控制的灵活性、生成的视频质量和时间连贯性等方面都有出色的表现。

您可以根据需要灵活调整生成风格的类型、卡通化程度等指标:

从demo中可以看出,VToonify生成的这些人像不仅具有高度可调的卡通风格,而且包含了很多人像的细节,有千人千面的感觉。所以很多网友表示,有了这个工具,制作动画电影是不是很轻松?

也有人想将其应用到 VR 领域。

当被问到是否可以用作实时滤波器时,作者表示:目前的模型还是很大的,要实现实时还需要一些工程上的努力。

论文概述

生成高质量的艺术肖像视频是计算机图形学和计算机视觉中的一项重要任务。尽管研究人员基于强大的 StyleGAN 提出了一系列成功的人像卡通模型,但这些面向图像的方法在应用于视频时存在明显的局限性,例如固定帧大小、人脸对齐要求、缺乏非人脸细节和时序不一致, ETC。

也就是说,一种有效的视频卡通化方法需要克服以下挑战:

为了满足上述要求,研究人员提出了一个专门用于视频卡通化的混合框架——VToonify。

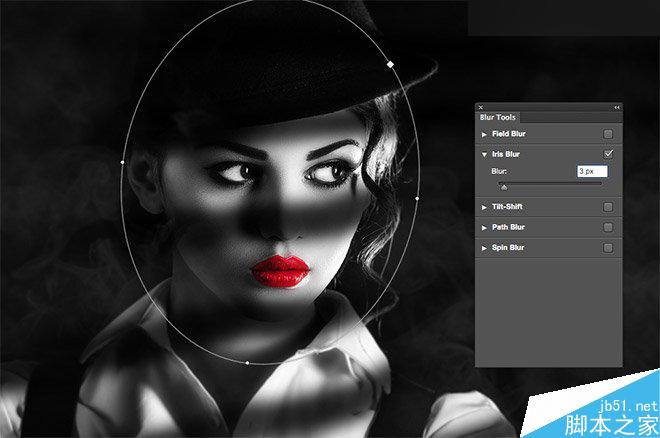

具体来说,他们首先分析了 StyleGAN 的平移同质性,这是克服“固定帧大小”限制的关键。如下图2(c)所示,VToonify结合了基于StyleGAN的框架和图像传输框架的优势,实现了可控的高分辨率人像视频风格迁移。

他们采用 [Pinkney and Adler 2020] 的 StyleGAN 架构进行高分辨率视频风格迁移,但通过移除固定大小的输入特征和低分辨率层来适应 StyleGAN 构建新的全卷积编码器-生成器架构,类似于图像转换框架中的一个,支持不同的视频大小。

除了原始的高级样式代码外,他们还训练编码器提取输入帧的多尺度内容特征作为生成器的附加内容条件,以便在样式转换过程中更好地保留帧的关键视觉信息。他们遵循 [Chen et al. 2019; Viazovetskyi 等人。2020] 在合成配对数据上提取 StyleGAN。

此外,他们进一步建议通过基于单个合成数据模拟相机运动中闪烁抑制的损失来消除闪烁。

因此,VToonify 无需真实数据、复杂的视频合成和显式光流计算即可学习快速且连贯的视频转换。

与 [Chen et al. 中的标准图像翻译框架不同。2019; Viazovetskyi 等人。2020],VToonify 将 StyleGAN 模型合并到生成器中,以提取数据和模型。因此,VToonify 继承了 StyleGAN 的风格调整灵活性。通过重用 StyleGAN 作为生成器,研究人员只需训练编码器,大大减少了训练时间和难度。

按照上述方法,我们提出了两个 VToonify 变体,基于两个具有代表性的 StyleGAN 主干——Toonify [Pinkney and Adler 2020] 和 DualStyleGAN [Yang et al. 2022]——分别用于基于收藏和示例的人像视频卡通化。

前者根据数据集的整体风格对人脸进行风格化,而后者则使用数据集中的图像来指定更精细的风格,如图1右上角所示。

研究人员通过采用 DualStyleGAN [Yang et al. 2022],并精心设计数据生成和训练目标。VToonify 继承了 DualStyleGAN 灵活的风格控制和风格度数调整,并将这些功能进一步扩展到视频(如图1右上角)

基于集合的人像视频风格迁移

在基于集合的人像视频风格迁移中,我们使用具有代表性的 Toonify 作为主干,它使用原始 StyleGAN 架构并且仅以风格代码为条件。

如图 4 所示,基于集合的 VToonify 框架由构建在 Toonify 之上的编码器和生成器组成。获取视频帧并生成内容特征,然后将其输入到最终的风格化肖像中。与现有的使用整个 StyleGAN 架构的基于 StyleGAN 的框架不同,它们仅使用顶级的 11 层 StyleGAN 构建。正如 [Karras et al. 2019],StyleGAN的低分辨率层和高分辨率层主要分别捕捉结构相关的风格和颜色/纹理风格。因此,主要任务是对内容特征进行上采样并为它们渲染风格化的颜色和纹理。

基于样本的人像视频风格迁移

在基于样本的人像视频风格迁移中,我们使用 DualStyleGAN 作为主干,它为 StyleGAN 添加了一条外部风格路径,其条件是内部风格代码、外部风格代码和风格度。内部风格代码描述了面部特征,外部风格代码描述了艺术肖像的外部结构和色彩风格。结构样式_和颜色样式_确定应用样式的强度。

基于示例的框架与上面提到的基于集合的框架有很多共同之处。它通过两次修改实现了灵活的样式控制。一是使用Modified ModRe实现结构风格控制,二是增加Style-Degree-Aware Fusion模块。完整的架构如图 9 所示。

实验结果

实验结果表明,VToonify 生成的风格化帧不仅与主干帧质量相同,而且更好地保留了输入帧的细节。

有关更多详细信息,请参阅原始论文。